- Nowy

1 854,23 zł Netto

Zaawansowany zestaw autonomicznego robota AI z architekturą dwukontrolerową, oparty na Jetson Nano, przeznaczony do pracy z ROS, mapowania LIDAR, przetwarzania obrazu oraz inteligentnej interakcji głosowej. Waveshare JetRacer ROS AI Kit B (EU)

JetRacer Professional Version ROS AI Kit B to profesjonalny zestaw robota mobilnego zaprojektowany do nauki, badań oraz weryfikacji algorytmów sztucznej inteligencji i robotyki. Zestaw spełnia wymagania projektów badawczych w obszarach takich jak mapowanie LIDAR, autonomiczna nawigacja, autonomiczna jazda, przetwarzanie obrazu, rozpoznawanie obiektów, rozpoznawanie twarzy oraz inteligentna komunikacja głosowa. Platforma jest w pełni kompatybilna z otwartym projektem NVIDIA JetRacer, a jednocześnie została znacząco rozbudowana sprzętowo w celu uzyskania wyższej wydajności i większych możliwości.

Produkt jest oficjalnym rozwiązaniem partnerskim NVIDIA.

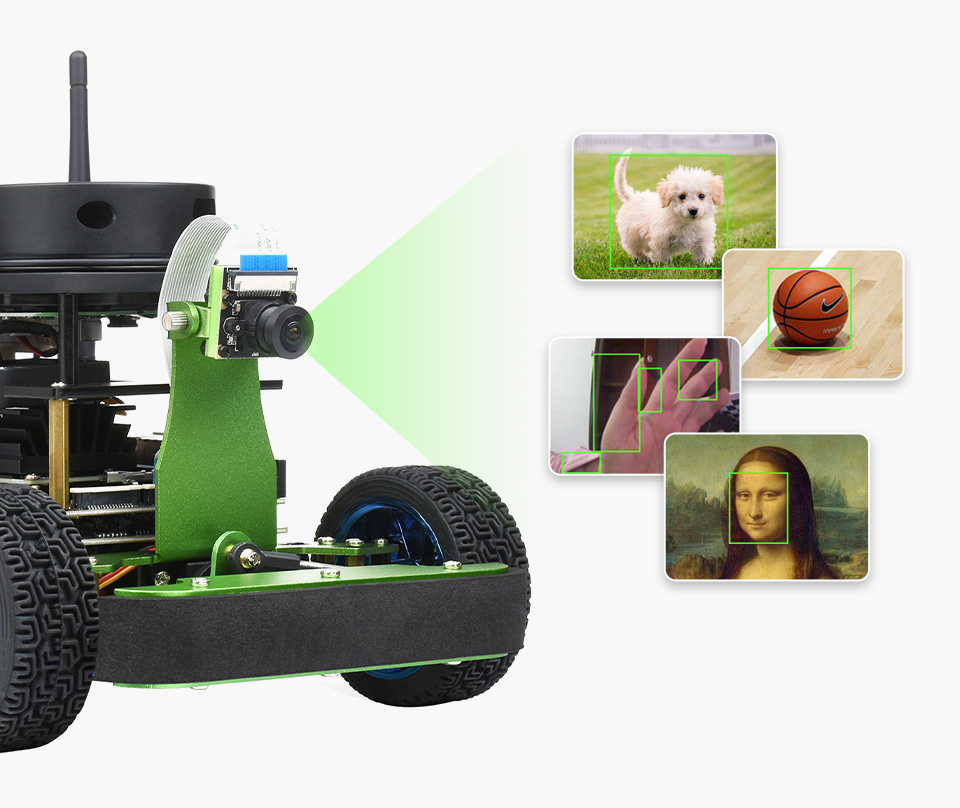

System wizyjny i przetwarzanie obrazu

Zestaw wyposażony jest w kamerę IMX219-160 o rozdzielczości 3280 × 2464 px i szerokim polu widzenia 160°. Kamera została zaprojektowana do zastosowań z biblioteką OpenCV i algorytmami AI. Umożliwia realizację takich funkcji jak:

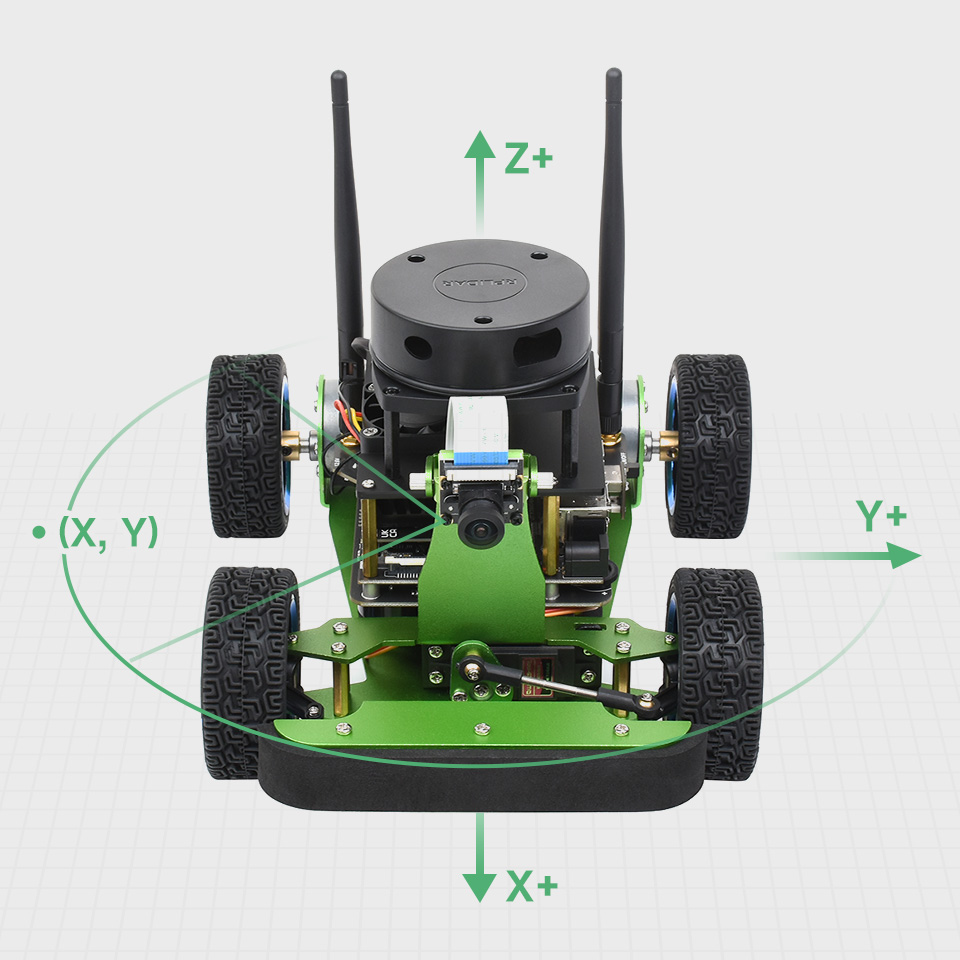

LIDAR i mapowanie przestrzeni

Robot wyposażony jest w RPLIDAR A1, umożliwiający 360-stopniowe skanowanie otoczenia. Dane z LIDAR-u wykorzystywane są do:

System wspiera algorytmy SLAM z wykorzystaniem danych z enkoderów, IMU i LIDAR-u, w tym Gmapping, Hector, Karto oraz Cartographer, a także nawigację opartą o AMCL i move_base.

Architektura dwukontrolerowa

Odpowiada za przetwarzanie obrazu, algorytmy AI, obsługę systemu ROS, mapowanie, nawigację, przetwarzanie mowy oraz zadania wymagające dużej mocy obliczeniowej. W wersji Kit B zastosowano Waveshare Jetson Nano Dev Kit z modułem Jetson Nano w wersji eMMC, bardziej odpowiednim do zastosowań produkcyjnych.

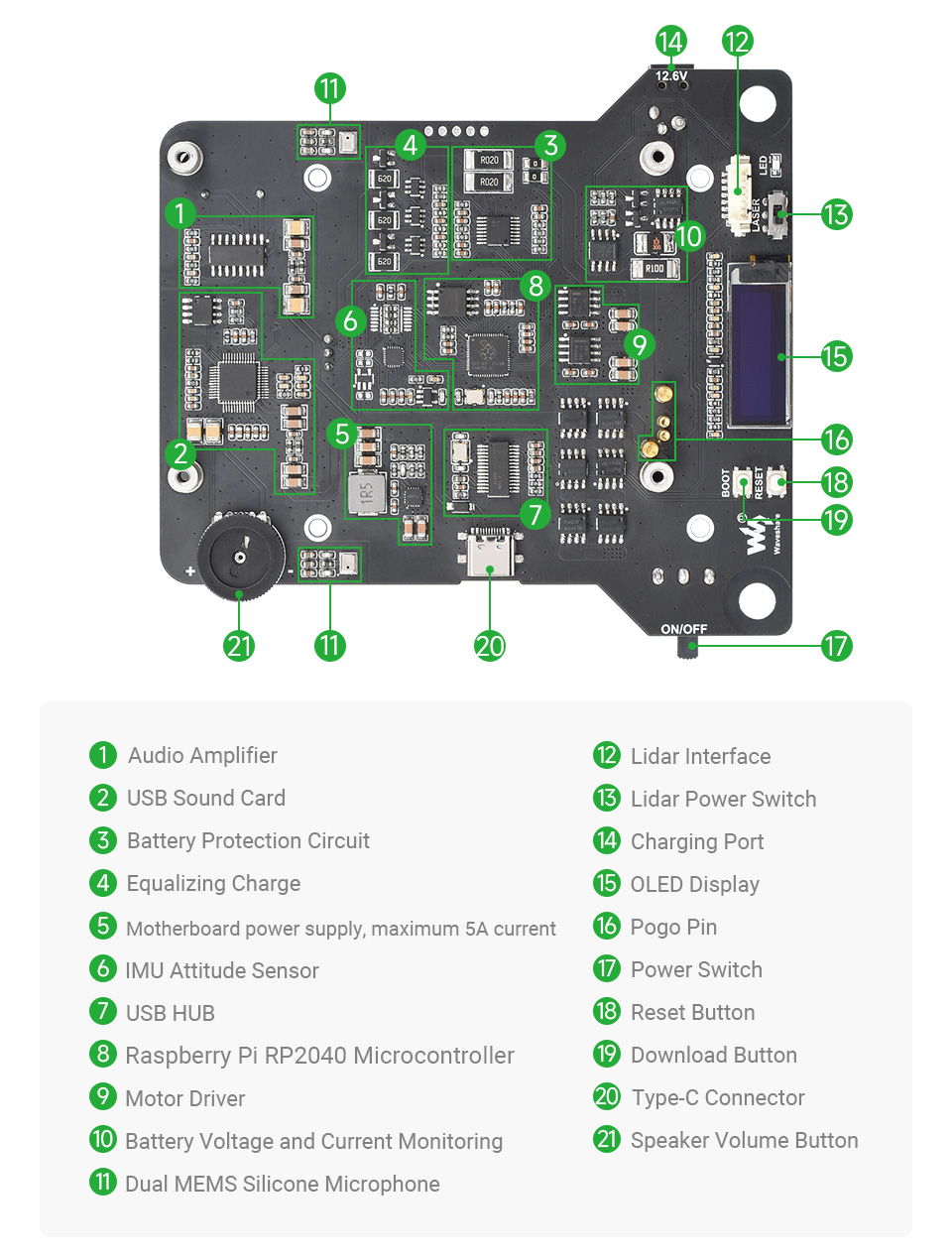

Dwurdzeniowy mikrokontroler o wysokich właściwościach czasu rzeczywistego, odpowiedzialny za sterowanie ruchem, obsługę silników, enkoderów, zbieranie danych z czujników oraz precyzyjną kontrolę pracy robota. Komunikacja pomiędzy kontrolerami odbywa się przez USB, co zapewnia wyższą prędkość transmisji niż UART.

Nawigacja autonomiczna i planowanie trasy

Po wskazaniu celu robot samodzielnie planuje trasę, omija przeszkody i aktualizuje mapę otoczenia w czasie rzeczywistym.

Robot obsługuje:

System audio i interakcja głosowa

Zestaw posiada dwa mikrofony MEMS oraz głośnik, oparte na układzie USB Audio. Umożliwia to:

Robot może „słuchać”, „rozumieć” i „odpowiadać” głosem, co umożliwia tworzenie projektów z zakresu inteligentnej interakcji.

Czujniki i stabilizacja

Zintegrowany 9-osiowy czujnik IMU współpracuje z enkoderami kół i filtrem Kalmana (EKF), zapewniając dokładne określenie orientacji robota i stabilną nawigację.

JetRacer wykorzystuje strukturę skrętu typu Ackermanna, łącząc:

Zastosowano wysokiej mocy silniki DC z metalową przekładnią i enkoderami AB-fazowymi, umożliwiające:

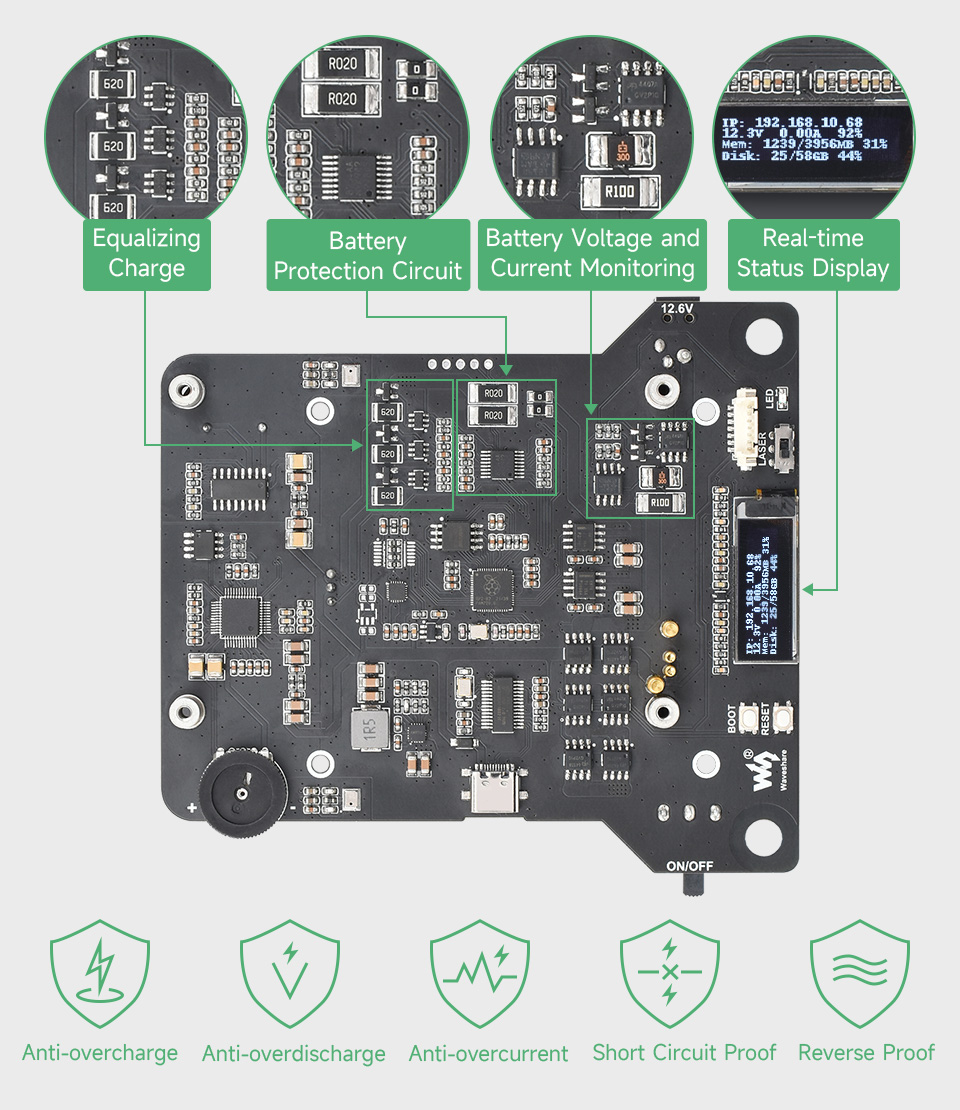

Zasilanie i bezpieczeństwo

Zintegrowany układ zasilania z ładowaniem wyrównawczym oraz zabezpieczeniami przed przeładowaniem, nadmiernym rozładowaniem, przeciążeniem, zwarciem i odwrotną polaryzacją, z pomiarem napięcia i prądu oraz podglądem parametrów w czasie rzeczywistym na wyświetlaczu OLED.

Odpowiada za przetwarzanie obrazu, algorytmy AI, obsługę systemu ROS, mapowanie, nawigację, przetwarzanie mowy oraz zadania wymagające dużej mocy obliczeniowej. W wersji Kit B zastosowano Waveshare Jetson Nano Dev Kit z modułem Jetson Nano w wersji eMMC, bardziej odpowiednim do zastosowań produkcyjnych.

Budowa płyty sterującej - przednia strona

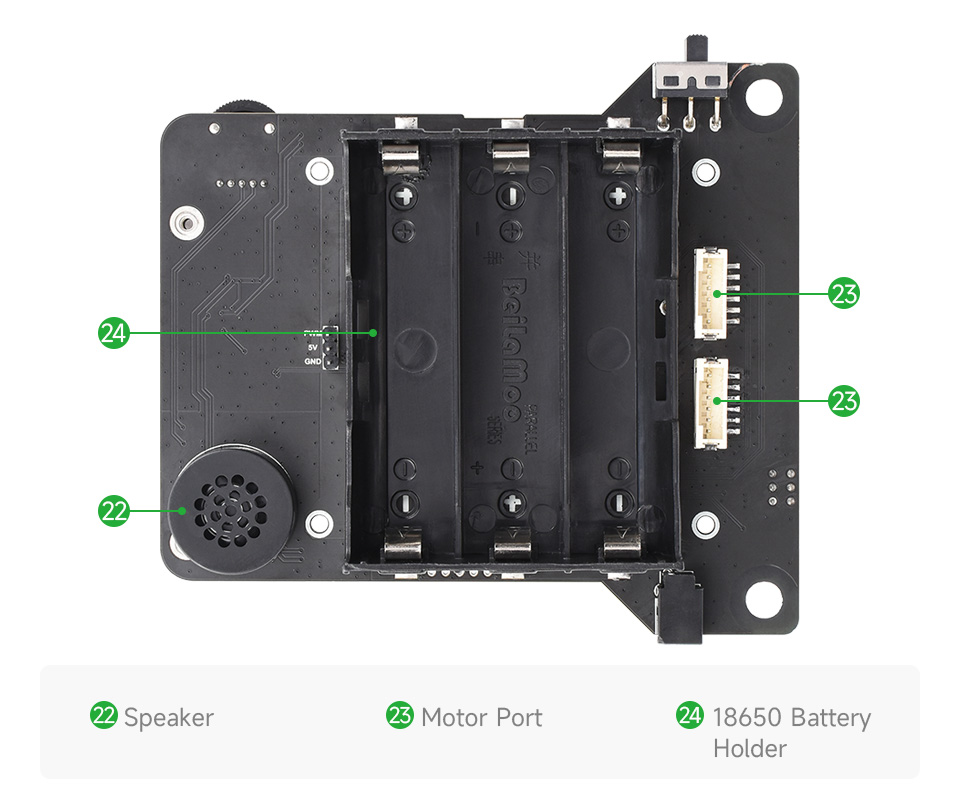

Budowa płyty sterującej - tylna strona

Producent BTC Korporacja sp. z o. o. Lwowska 5 05-120 Legionowo Polska sprzedaz@kamami.pl 22 767 36 20

Osoba odpowiedzialna BTC Korporacja sp. z o. o. Lwowska 5 05-120 Legionowo Polska sprzedaz@kamami.pl 22 767 36 20

Zestaw do budowy inteligentnego robota JetBot na bazie Jetson Nano. Składa się z zestawu deweloperskiego, modułu rozszerzeń, kamery z czujnikiem obrazu IMX219, czujnika LIDAR, silników, podstawy jezdnej i 9-osiowego IMU. Waveshare JetBot ROS AI Kit B

Brak towaru

Zestaw do budowy autonomicznego robota wyścigowego w oparciu o NVIDIA Jetson Nano. Waveshare JetRacer Pro AI Kit A

Brak towaru

Zestaw do budowy inteligentnego robota JetBot na bazie Jetson Nano. Składa się z modułu rozszerzeń, kamery z czujnikiem obrazu czujnika LIDAR, silników, podstawy jezdnej i 9-osiowego IMU. Waveshare JetBot ROS AI Kit Acce (EU)

Zestaw do budowy inteligentnego robota JetBot na bazie Jetson Nano B01. Składa się z zestawu deweloperskiego, modułu rozszerzeń ze złączami, kamery, silników, obudowy i zestawu śrubek montażowych. Waveshare JetBot AI Kit A

Brak towaru

Zestaw do budowy autonomicznego robota wyścigowego w oparciu o NVIDIA Jetson Nano. Waveshare JetRacer AI Kit A

Brak towaru

Zestaw akcesoriów do budowy autonomicznego robota wyścigowego w oparciu o popularny zestaw deweloperski NVIDIA Jetson Nano. Waveshare JetRacer 2GB AI Kit Acce

Brak towaru

Zestaw akcesoriów do budowy autonomicznego robota wyścigowego w oparciu NVIDIA Jetson Nano. Waveshare JetRacer ROS AI Kit Acce (EU)

Brak towaru

Zestaw do budowy wielozadaniowego robota z podwoziem gąsienicowym w oparciu o popularny zestaw deweloperski NVIDIA Jetson Nano. Waveshare JETANK AI Kit

Brak towaru

Zestaw do budowy inteligentnego robota JetBot na bazie Jetson Nano. Składa się z zestawu deweloperskiego, modułu rozszerzeń, kamery z czujnikiem obrazu IMX219, czujnika LIDAR, silników, podstawy jezdnej i 9-osiowego IMU. Waveshare JetBot ROS AI Kit A

Brak towaru

Zestaw do budowy inteligentnego robota JetBot na bazie Jetson Nano. Składa się z Jetson Nano, modułu rozszerzeń ze złączami, kamery, silników, obudowy i zestawu śrubek montażowych. Waveshare JetBot AI Kit

Brak towaru

Zestaw akcesoriów do budowy autonomicznego robota wyścigowego w oparciu o popularny zestaw deweloperski NVIDIA Jetson Nano. Waveshare JetRacer AI Kit Acce

Otwarta platforma robota mobilnego gąsienicowego Waveshare UGV Beast PT przeznaczona do pracy z modułami NVIDIA Jetson Orin, wyposażona w podwójny kontroler, obrotową wieżę pan-tilt o zakresie 360° oraz środowisko ROS2 do zastosowań terenowych i projektów AI. Dostępna opcjonalnie w wersji z Jetson Orin Nano 4GB. Waveshare UGV Beast PT Jetson Orin ROS2 Kit

Brak towaru

Zestaw akcesoriów do budowy wielozadaniowego robota z podwoziem gąsienicowym w oparciu o popularny zestaw deweloperski NVIDIA Jetson Nano. Waveshare JETANK AI Kit Acce

Zestaw akcesoriów do budowy autonomicznego robota wyścigowego w oparciu o popularny zestaw deweloperski NVIDIA Jetson Nano. Waveshare JetRacer Pro 2GB AI Kit Acce

Brak towaru

Zestaw do budowy autonomicznego robota wyścigowego w oparciu o NVIDIA Jetson Nano Dev Kit. Waveshare JetRacer ROS AI Kit B

Zestaw do budowy inteligentnego robota JetBot na bazie Jetson Nano. Składa się z modułu rozszerzeń, kamery z czujnikiem obrazu czujnika LIDAR, silników, podstawy jezdnej i 9-osiowego IMU. Waveshare JetBot ROS AI Kit Acce

Brak towaru

Zaawansowany zestaw autonomicznego robota AI z architekturą dwukontrolerową, oparty na Jetson Nano, przeznaczony do pracy z ROS, mapowania LIDAR, przetwarzania obrazu oraz inteligentnej interakcji głosowej. Waveshare JetRacer ROS AI Kit B (EU)